今日における最大級のコンピューティング課題に取り組むには、強大なコンピューティング能力が必要。

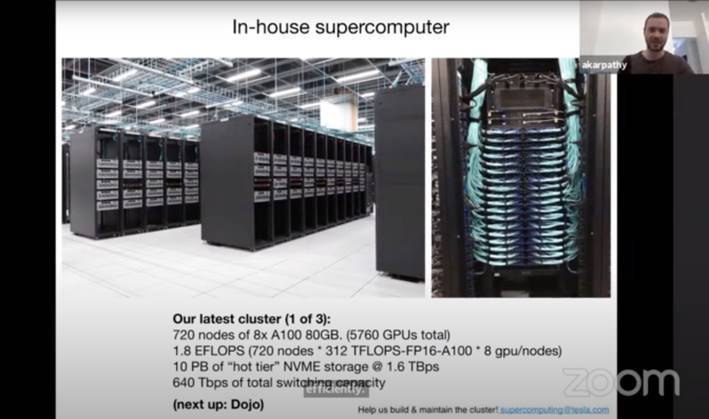

世界的学会「Computer Vision and Pattern Recognition」で、Tesla(以下、テスラ)のAI担当シニアディレクターであるアンドレイ カルパシー(Andrej Karpathy)氏は、同社が自動操縦および自動運転機能向けのディープニューラルットワーク(以下、DNN)をトレーニングするために使用している自社スーパーコンピューターについて明らかにした。

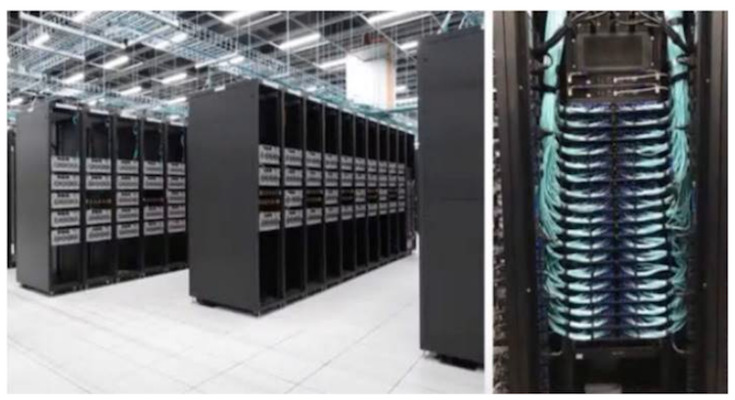

クラスターは業界最高水準の1.8エクサフロップスの性能を実現するため、8基の「NVIDIA A100 Tensor コア GPU」を搭載するノードを720台(合計5,760基のGPU)使用している。自動車業界では前例のないレベルのコンピューティング能力を開発サイクルの中心に据え、テスラは自動運転車のエンジニアが効率的かつ最先端の技術でライフワークに取り組めるようにしている。

カルパシー氏は次のように述べている。

「これは本当に素晴らしいスーパーコンピューターです。フロップスに関して言えば、世界でおおよそ5位のスーパーコンピューターと言えるでしょう。」

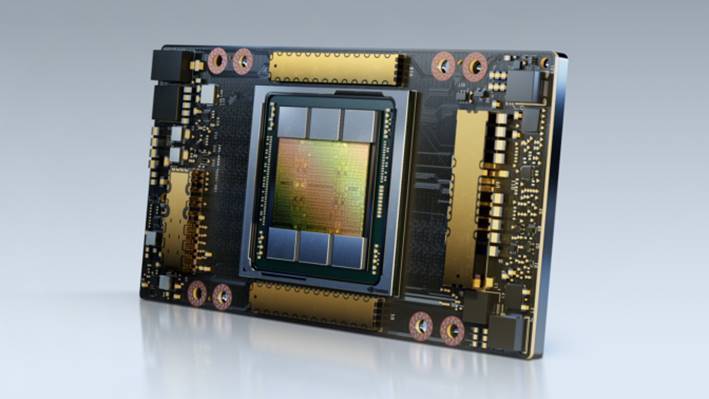

NVIDIA A100 GPUは世界最高性能のデータセンターを実現するためにあらゆる規模のアクセラレーションを提供する。NVIDIA Ampereアーキテクチャを採用するA100 GPUは、前世代と比較して最大20倍の性能を提供し、7つのGPUインスタンスに分割することで、需要の変化に動的に対応することができる。

車両からデータセンターへ

テスラの循環型開発は車両から始まる。「シャドウモード」で動作するディープニューラルネットワークは車両走行中に静かに認識し、予測を立てるが実際に車両を制御することはない。予測は記憶され、間違いや誤認はすべてログに記録される。次にこれらのインスタンスを使用して、テスラのエンジニアが難易度の高い多様なシナリオのトレーニングデータセットを作成し、DNNの精度向上を目指す。

その結果、36フレーム/秒(fps)で記録された10秒間のクリップがおよそ100万点、実に1.5ペタバイトに上るデータ集が出来上がる。これらのシナリオをDNNがデータセンターで実行し、1つのミスもなく動作するまで何度も繰り返す。最後にDNNを車両に送り返し、一連のプロセスを再び開始する。

カルパシー氏はこのような手法でこれほど大量のデータを基にDNNをトレーニングするには「膨大なコンピューティング」が必要だと述べ、高性能なA100 GPUを搭載する現世代のスーパーコンピューターの構築と活用に踏み切った。

継続的な反復処理

包括的なトレーニングに加え、Teslaのスーパーコンピューターは自動運転車のエンジニアが開発プロセスにおいて実験や反復作業を行うために必要な性能を提供する。カルパシー氏は同社が展開している現在のDNNの構造では、20人のエンジニアを有するチームが同時に単一のネットワークを扱い、さまざまな機能を分離して並列に開発できると述べている。これらのDNNはこれまでよりも高速にトレーニングデータセットを実行できるため、迅速な反復作業が可能になる。

カルパシー氏は次のように述べている。「コンピュータービジョンは私たちの仕事の根幹であり、Autopilotを可能にします。機能するためには大規模なニューラルネットワークをトレーニングし、数多くの実験を重ねる必要があります。だからこそ、私たちはコンピューティングに多額の投資を行ってきたのです。」

からの記事と詳細 ( テスラが「自動運転車トレーニング用のスーパーコンピュータ」を公開 NVIDIA A100 GPUを搭載、その仕様は・・ - ロボスタ )

https://ift.tt/3A4kU7g

No comments:

Post a Comment